你是不是也曾被 Kubernetes 的复杂命令搞得头昏脑涨?想查个 Pod 状态要敲一堆命令,部署个应用还得翻文档?

别慌,今天给大家介绍一个神器 —— kubectl-ai!它就像你的 Kubernetes “私人助理”,用 AI 帮你把复杂操作变得像点外卖一样简单!快来跟我一起看看这个 “黑科技” 有多香吧!

啥是 kubectl-ai?它能干啥?

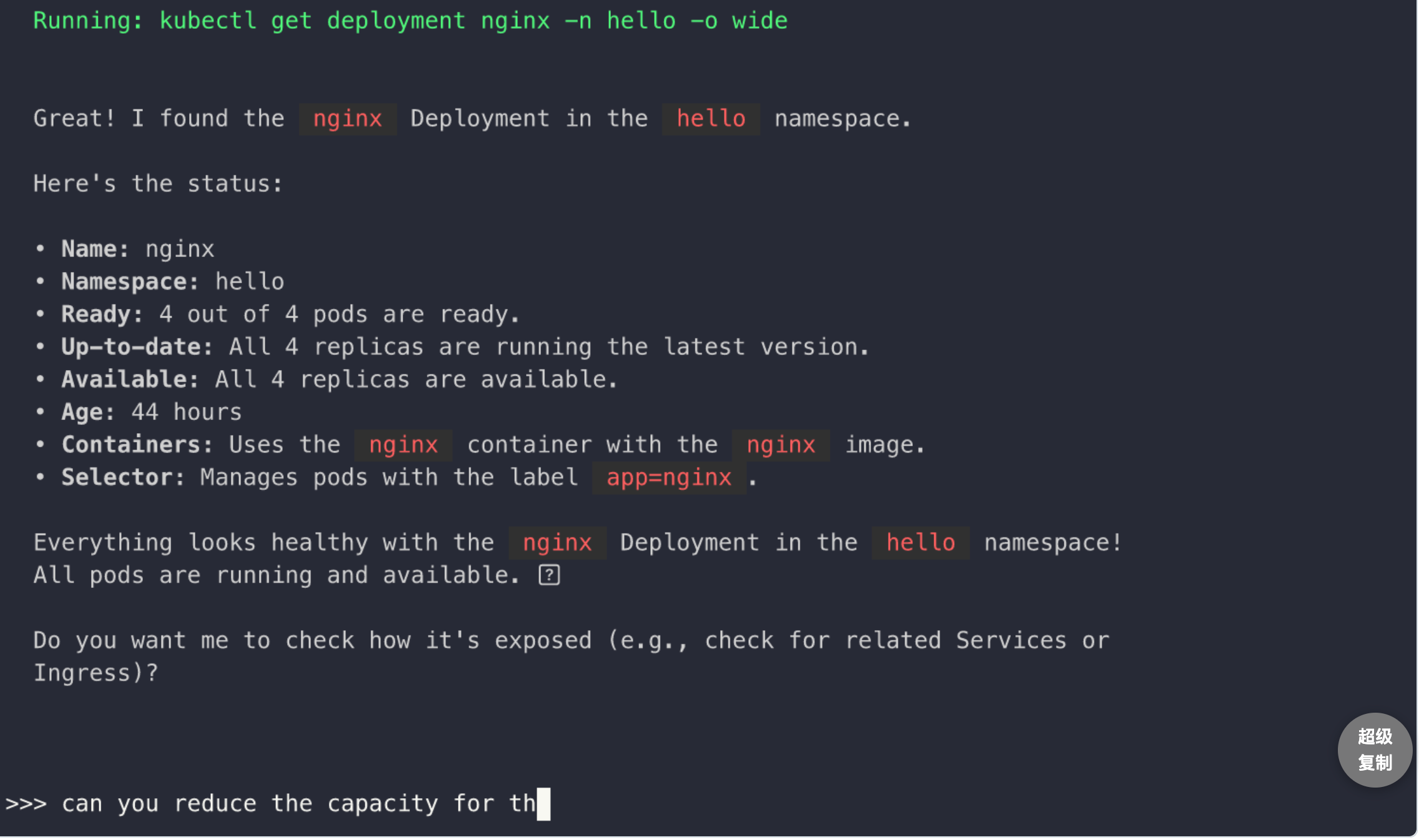

简单来说,kubectl-ai 是一个跑在你终端里的 AI 小助手,专门为 Kubernetes 量身打造。它能听懂你的“ 人话”,然后自动翻译成 kubectl 命令,帮你快速完成任务。想知道 Nginx 应用咋样了?直接问它!想扩容 Pod?一句话搞定!

它的核心功能有这些:

- 自然语言操作:用日常语言跟它聊天,它就能帮你查日志、部署应用、扩缩容啥的。

- 多平台支持:支持 Google Gemini、Azure OpenAI、OpenAI,甚至本地的 Ollama 和 llama.cpp模型,灵活到飞起!

- 交互模式:像跟朋友聊天一样,随时问问题,它还能记住上下文,超贴心。

- 管道操作:支持跟 Unix命令结合,处理日志、错误分析 so easy!

- 插件模式:直接当kubectl插件用,命令行玩家福音。

是不是听起来就很带劲?别急,下面带你看看怎么用它 “开挂”!

Github 项目地址:https://github.com/GoogleCloudPlatform/kubectl-ai

安装kubectl-ai:三步走,简单到爆!

安装 kubectl-ai 就像装个手机 App,简单得让人想笑!前提是你得先装好 kubectl(Kubernetes的命令行工具)。准备好了?跟着我来!

- 第一步:下载

去 GitHub releases 页面,找到适合你设备的版本(Mac、Linux、Windows都有)。点一下,下载就完事儿!

- 第二步:解压 & 授权

下载后是个压缩包,解压它,赋予可执行权限,再扔到你的 PATH 目录里。比如 Mac 用户可以这么干:

1 | $ tar -zxvf kubectl-ai_Darwin_arm64.tar.gz |

这不比装个游戏还快?

- 第三步:设置 API 密钥

kubectl-ai 默认用 Google Gemini 的 AI 模型,所以得先去Google AI Studio搞个API密钥。拿到密钥后,设置一下环境变量:

1 | $ export GEMINI_API_KEY=你的密钥 |

搞定!现在你就可以召唤 AI 助手了!

用 kubectl-ai 有多爽?一句话搞定复杂操作!

装好了 kubectl-ai,接下来就是见证奇迹的时刻!它支持两种玩法:交互模式和单命令模式。不管你是喜欢聊天还是直接干活,都能满足你!

交互模式:像跟 AI 朋友聊天

直接在终端输入:

1 | $ kubectl-ai |

这时候你就进入了一个 “AI聊天室”。想干啥直接说,比如:

- “Nginx 应用在集群里咋样了?”

- “帮我看看 hello 命名空间的日志!”

- “给我部署个 3 副本的 Nginx 应用!”

它会秒懂你的需求,自动生成 kubectl 命令,执行后还给你解释结果。问完一个问题还能接着问,上下文它都记得!

想退出?输入 exit 或按 Ctrl+C 就行。

单命令模式:快如闪电

如果你是个 “速战速决” 型选手,可以直接带任务跑命令。比如:

1 | $ kubectl-ai -quiet "fetch logs for nginx app in hello namespace" |

结果立马出来,干净利落!还能跟 Unix 命令玩配合,比如:

1 | $ echo "list pods in the default namespace" | kubectl-ai |

甚至还能分析错误日志:

1 | $ cat error.log | kubectl-ai "explain the error" |

这效率,简直是 Kubernetes 界的 “外挂”!

灵活到炸!支持多种AI模型

kubectl-ai 的另一个大杀器是它支持超多 AI 模型。不管你是云端玩家还是本地党,总有一款适合你!

默认玩法:Google Gemini

Gemini 是默认模型,速度快、效果好。想换个型号?比如用更快的 Gemini 2.5 Flash:

1 | $ kubectl-ai --quiet --model gemini-2.5-flash-preview-04-17 "check logs for nginx app in hello namespace" |

本地党福音:Ollama & llama.cpp

不想依赖云端?可以用本地的 Ollama 或 llama.cpp 跑 AI 模型。比如用 Google 的 Gemma 模型:

1 | $ kubectl-ai --llm-provider ollama --model gemma3:12b-it-qat --enable-tool-use-shim |

还能用 models 命令看看本地有啥模型,简直不要太方便!

企业级选择:Azure OpenAI & OpenAI

如果你公司用 Azure OpenAI 或 OpenAI 的模型,也没问题!设置好 API 密钥和端点就行:

1 | $ export AZURE_OPENAI_API_KEY=你的密钥 |

OpenAI 同理,支持 GPT-4.1等型号,高端大气上档次!

小彩蛋:kubectl-ai 的 “魔法” 指令

除了干活,kubectl-ai 还有几个超实用的小功能,堪称 “魔法”:

- 输入 model:看看当前用的 AI 模型。

- 输入 models:列出所有可选模型。

- 输入 reset:清空聊天上下文,重新开始。

- 输入 clear:清屏,强迫症患者福音。

- 输入 exit:退出交互模式,优雅说再见。

这些小功能就像给你的 AI 助手加了个遥控器,想咋玩就咋玩!

当 kubectl-ai 变身 kubectl 插件

如果你是 kubectl 的铁粉,好消息!kubectl-ai 还能当 kubectl 插件用。只要它在你的 PATH 里,输入:

1 | $ kubectl ai |

就能直接用,丝滑到不行!想了解更多插件知识?戳Kubernetes官网 看看吧!

实战案例:从新手到大神就差一个 kubectl-ai

来点实际的例子,让你感受 kubectl-ai 的威力!

- 例1:查Pod状态

新手:敲一堆 kubectl get pods -n default。

大神:kubectl-ai -quiet "show me all pods in the default namespace"。 结果秒出,还带解释!

- 例2:部署应用

新手:翻文档,写一堆 YAML 文件。

大神:kubectl-ai -quiet "create a deployment named nginx with 3 replicas using the nginx:latest image"。 几秒钟,部署完成!

- 例3:扩容

新手:查命令,敲 kubectl scale。

大神:kubectl-ai --llm-provider=openai --model=gpt-4.1 -quiet "scale the nginx deployment to 5 replicas"。 效率直接起飞!

是不是感觉自己离 “Kubernetes 大神” 只差一个 kubectl-ai?

k8s-bench:AI模型谁更牛?

kubectl-ai 还自带一个 “k8s-bench” 工具,专门测 AI 模型在 Kubernetes 任务上的表现。最新报告显示:

| 模型 | 成功 | 失败 |

|---|---|---|

| Gemini 2.5 Flash | 10 | 0 |

| Gemini 2.5 Pro | 10 | 0 |

| Gemma 3 27B | 8 | 2 |

Gemini 系列全胜,Gemma 也不赖!想看详细报告?点这里 !

为啥你必须试试 kubectl-ai?

用了 kubectl-ai,我才发现:原来 Kubernetes 可以这么简单!

它就像一个超级聪明的 “实习生”,不仅能干活,还能解释清楚。它让运维小白也能快速上手,让老司机效率翻倍!

更重要的是,它开源、免费,还支持多种 AI 模型,简直是 “平民版 AI 神器”。不管你是开发、运维,还是科技爱好者,kubectl-ai 都能让你在 Kubernetes 的世界里如鱼得水!

你用过 kubectl-ai 了吗?觉得它咋样?快在评论区分享你的 “开挂” 体验吧! !